Latent Dirichlet Allocation (2003)

简介¶

该篇论文于2003年发表在“Journal of Machine Learning Research”期刊上,迄今引用次数已超过15000次,可见该论文对后来相关研究工作的影响之大。

首次正式将主题以隐变量的形式引入,形成一个三层贝叶斯模型,并且相比于之前和它最接近的pLSI文本模型,LDA的主题选取不再受训练集文本内容的束缚,是一个完全非监督且依据多个主题进行聚类的机器学习、数据挖掘领域的算法。

现实意义¶

在推荐系统的研究中,利用评论文本信息来提升推荐性能是近3-4年的一个热门研究领域,LDA及其改良的文本模型则是用来挖掘评论文本的主要方式。

早期文本模型¶

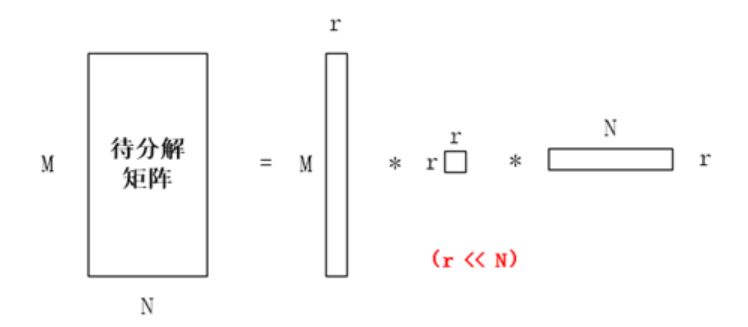

LDA的建模介绍¶

- 用来训练文档的是基本块

- 每条指令说word

- 柏松分布

用变分推理求解LDA模型的参数¶

最重要的是LDA模型的两个参数,确定了后能在未知的文本里提取主题

Gensim简介、LDA编程实现、LDA主题提取效果图展示¶

- 统计词语出现的频率

- 为什么例子里的没有迭代次数呢?

- 调研为什么要pytorch tenceflow

需要进一步的研究学习¶

暂无

遇到的问题¶

暂无

开题缘由、总结、反思、吐槽~~¶

参考文献¶

https://zhuanlan.zhihu.com/p/28777266

https://blog.csdn.net/fish0058/article/details/25075591

https://blog.csdn.net/anqiu4023/article/details/102275607

https://pypi.python.org/pypi/lda

http://scikit-learn.org/dev/modules/generated/sklearn.decomposition.LatentDirichletAllocation.html#sklearn.decomposition.LatentDirichletAllocation